Il file robots.txt si trova all'interno della directory di un sito web e fornisce ai bot regole su quali pagine o file devono essere accessibili. Funziona come un insieme di linee guida che i proprietari di siti web usano per il controllo di come i motori di ricerca e altri bot interagiscono con i loro siti web.

Perché il file robots.txt è importante

Il file Robots.txt influisce direttamente sull'ottimizzazione per i motori di ricerca di un'organizzazione e sul posizionamento delle pagine nei risultati di ricerca. Gli scraper legittimi fanno riferimento al file Robots.txt ogni volta che estraggono e indicizzano i contenuti. Inoltre, anche i motori di ricerca più diffusi come Googlebot hanno quello che è noto come crawl budget, e il file Robots.txt lo influenza direttamente. Il crawl budget si riferisce al numero di pagine che un web scraper indicizzerà in un determinato periodo di tempo. Poiché un sito web può includere più pagine di quante ne consenta il suo crawl budget, i file robots.txt permettono alle organizzazioni di dare priorità al crawling delle pagine più pertinenti ed escludere quelle duplicate o non pubbliche.

I bot scraper dannosi non rispettano le linee guida di robots.txt e spesso tentano di accedere a parti del sito web esplicitamente vietate al suo interno. Considera i file robots.txt come linee tracciate nella sabbia per tenere sotto controllo i bot legittimi. Sebbene sia possibile seguirne le linee guida, oltrepassarle è semplicemente una decisione etica e non è in alcun modo limitato dalle regole del file robots.txt stesse. Tuttavia, le applicazioni in genere eseguono altri strumento di sicurezza che consentono di aggiungere protezione all'applicazione e ai suoi file o directory sensibili. Molti strumento di sicurezza prestano molta attenzione ai file robots.txt, poiché possono essere usati come honeypot per individuare rapidamente i bot dannoso nelle loro applicazione!

Come creare un file robots.txt

Ci sono alcuni punti da tenere a mente quando si creano file robots.txt:

Il file deve trovarsi nella directory root del dominio e ogni sottodominio deve avere il proprio file.

Il protocollo robots.txt distingue tra maiuscole e minuscole.

È facile bloccare accidentalmente il crawling di tutto, quindi assicurati di comprendere la sintassi di un comando prima di implementarlo:

Disallow: / significa non consentire nulla.

Disallow: significa non vietare nulla, il che consentirà tutto.

Allow: / significa consentire tutto.

Allow: significa non consentire nulla, il che impedirà tutto.

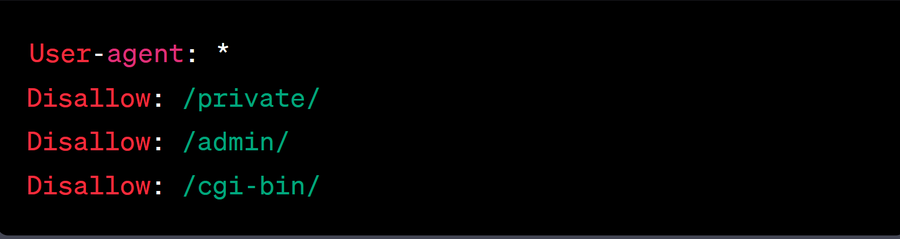

Ecco un esempio di un file robots.txt Basic:

In questo esempio, l'asterisco (*) nel campo "User-agent" indica che le regole si applicano a tutti i web robot. Il codice "Disallow" specifica le directory o i file che non devono essere sottoposti a scansione dai robot e "/private/," "/admin/," e "/cgi-bin/" sono le directory escluse specificate. Utilizzando questa logica, gli amministratori possono definire con precisione dove i bot non devono effettuare il crawling e possono estenderla a tutte le posizioni desiderate.

Il file robots.txt consente alle organizzazioni di decidere a quali pagine può accedere un crawler, ma può anche limitare la velocità con cui un crawler opera. La direttiva crawl delay è una direttiva non ufficiale che le organizzazioni possono usare per limitare il numero di richieste che un crawler effettua in un periodo di tempo. Così facendo si limita la capacità di un crawler di sovraccaricare un server e le organizzazioni possono implementare un ritardo di scansione per un particolare crawler o per tutti quelli che supportano la direttiva. È importante notare che, mentre motori di ricerca come Yahoo e Bing seguiranno questa direttiva non ufficiale, altri (come Googlebot) richiederanno modifiche nelle loro console specifiche per ottenere lo stesso risultato.

Riepilogo

I proprietari di siti web creano il file robots.txt per guidare i bot nelle loro applicazioni. Mentre i bot legittimi usano queste informazioni per capire quali pagine sottoporre a crawling, i bot scraper dannosi le ignorano ed eseguono il crawling ovunque vogliano. Scopri di più sui tipi di bot interessati dai file robots.txt qui.